Lidar: So sehen autonome Autos ihre Umgebung

Autonom fahrende Autos müssen selbstständig sehen. Eine Schlüsseltechnologie dafür heißt Lidar. Wie und was sie sieht, steht im Artikel.

Autos der Zukunft fahren autonom. Warum? Weil es sich lohnt: Der VW-Konzern schätzt, dass der Markt für autonome Fahrservices ungefähr 30 Milliarden Euro stark werden wird. General Motors rechnet sogar mit 50 Milliarden Euro. Grund genug für viele Automobilhersteller, Tech-Firmen und Startups, Roboterautos zu entwickeln, die keinen Fahrer benötigen. Sie sollen in naher Zukunft vollautomatisch Passagiere und Waren transportieren. Und, natürlich, damit Geld verdienen. Indien wollte übrigens 2017 autonome Autos verbieten: Die Technologie vernichte Arbeitsplätze.

Bevor es so weit sein wird, müssen die Hersteller noch diverse technische Hürden meistern. Die wichtigste: Autonome Autos müssen ihre Umgebung sehen, sie verstehen und darauf reagieren. Besonders die ersten zwei Punkte sind anspruchsvoll. Sie erfordern zuverlässige Sensoren und eine kluge Software, die alle Daten richtig interpretieren kann. Dabei muss das Auto mehr wahrnehmen als ein Mensch. Denn bei Roboterautos gilt eine Null-Fehler-Toleranz. „Habe ich nicht gesehen“ gibt es nicht.

Das Lidar als Schlüssel zur Autonomie

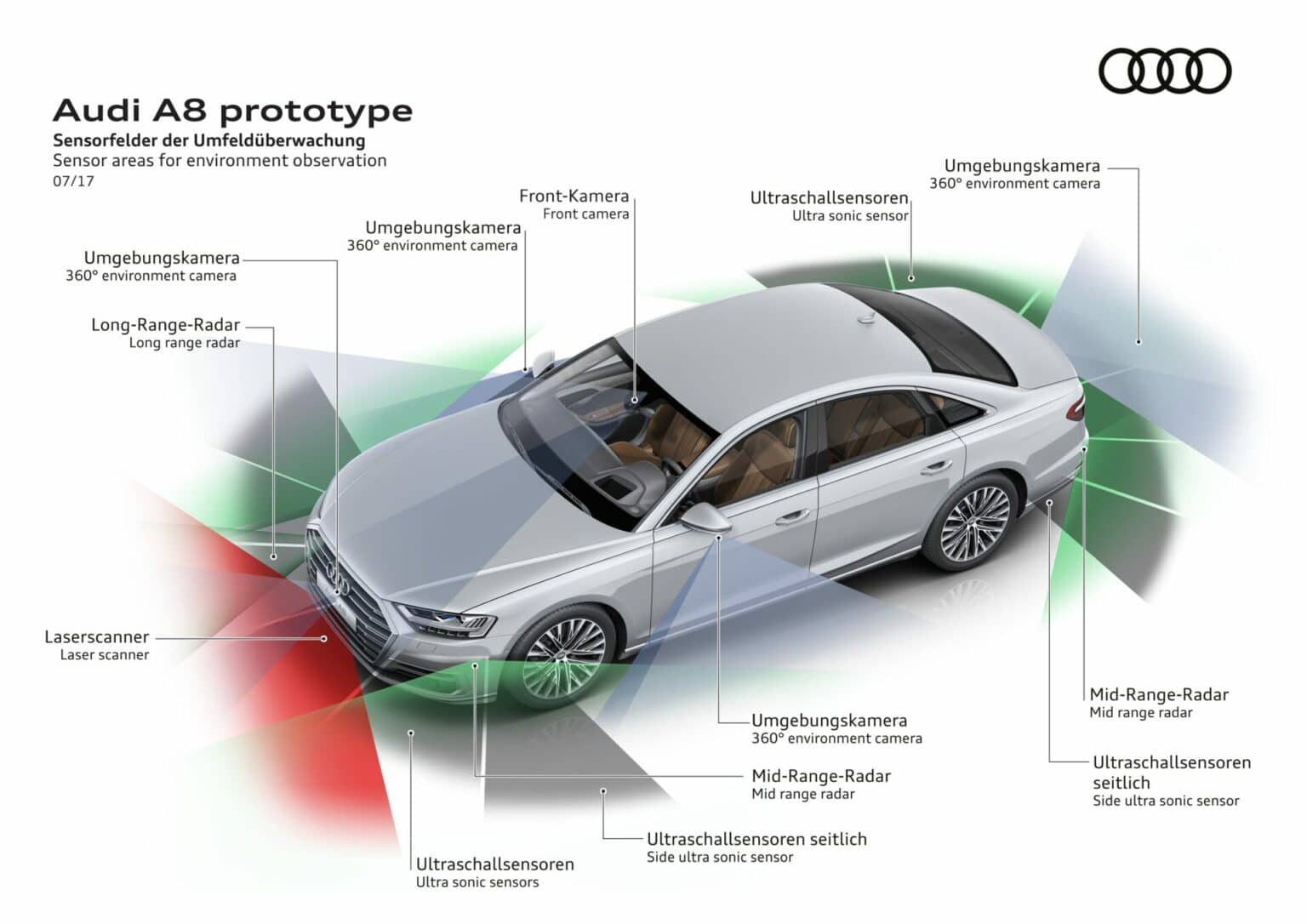

Aktuelle teilautonome Funktionen, zum Beispiel der Abstandstempomat und der Spurhalteassistent, sind bereits geläufig. Sie verlassen sich vor allem auf Kamerabilder, Radar- und Ultraschallsensoren. Die Autos erkennen damit Abstände (wie weit sind Hindernisse entfernt?) und können relative Geschwindigkeiten berechnen (fährt das Auto vor mir langsamer?). Außerdem nehmen sie Verkehrszeichen wahr und interpretieren sie (wie schnell darf ich hier fahren?). Die Erfahrung zeigt: In der Praxis passieren den Programmen noch Fehler. Deshalb gelten diese Ausstattungen als rein unterstützende Assistenten.

Auf dem Weg zum wirklich selbständig fahrenden Auto ist für diese Fehler kein Platz mehr. Deshalb ergänzt in autonomen Autos ein weiterer Sensortyp zusätzliche Daten: Der Laser-Scanner, das sogenannte Lidar. Es kreiert gemeinsam mit den bestehenden Sensoren ein digitales 3D-Bild der Umgebung. Das Lidar ist heute (Stand: Herbst 2021) noch eine Ausnahme in Fahrzeugen. Für die meisten Entwickler ist echte Autonomie ohne das Lidar nicht vorstellbar.

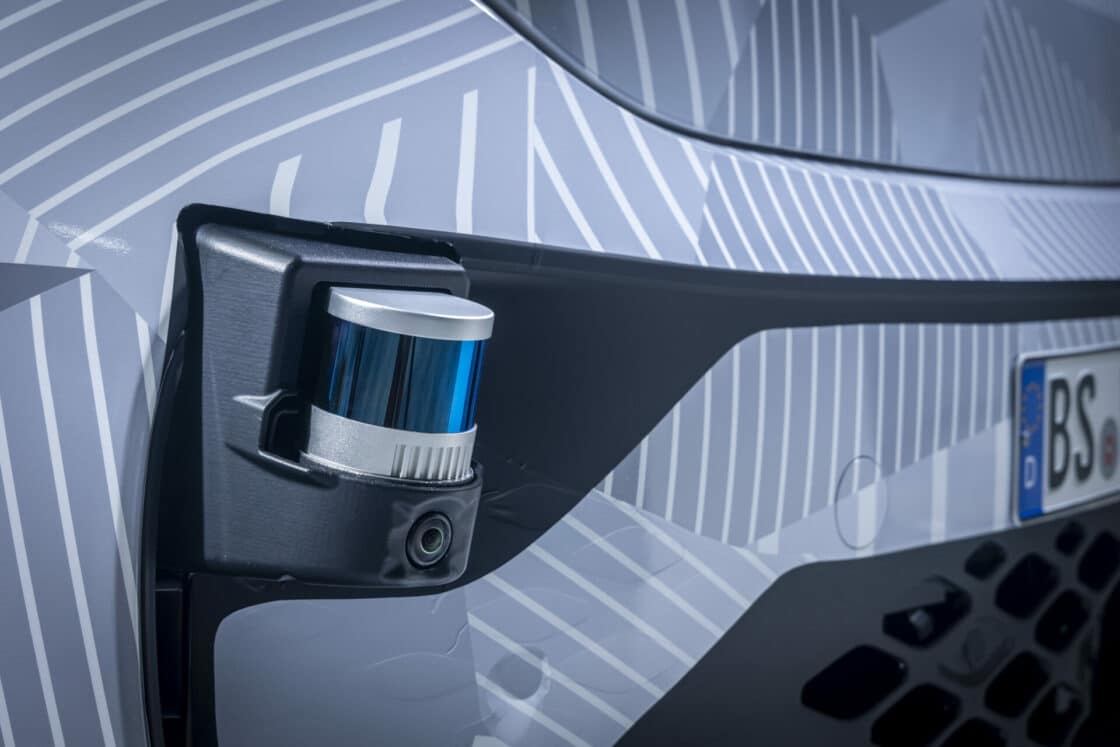

Der Grund für Lidar sind die Schwächen der anderen, etablierten Systeme. Ultraschallsensoren haben nur eine kurze Reichweite. Radarsensoren können Kanten nicht gut erkennen. Kameras benötigen gute Licht- und Sichtverhältnisse. Gemeinsam mit einem Lidar entsteht ein Sensorsystem, das bestmögliche digitale Rundumsicht gewährleistet. Als erster Hersteller begann Audi 2017 damit, Lidar-Geräte in Serienautos einzubauen. Bisher helfen die Lidar-Daten nur in den genannten, assistierenden Funktionen.

So funktioniert ein Lidar

Ein Lidar für den Automobilbereich kann man sich ungefähr so vorstellen wie einen komplexen CD-Player: Er emittiert Laserstrahlen, die von Objekten in der Umgebung reflektiert werden. Das Gerät misst die Dauer, die das reflektierte Signal benötigt, um wieder am Lidar anzukommen. Über Lichtgeschwindigkeit und Zeit berechnet es die Entfernung. Diese Konstruktion nennt sich ToF-Lidar, eine Abkürzung für Time of Flight. Gemeint ist dabei die Zeit, die der Lichtstrahl unterwegs ist.

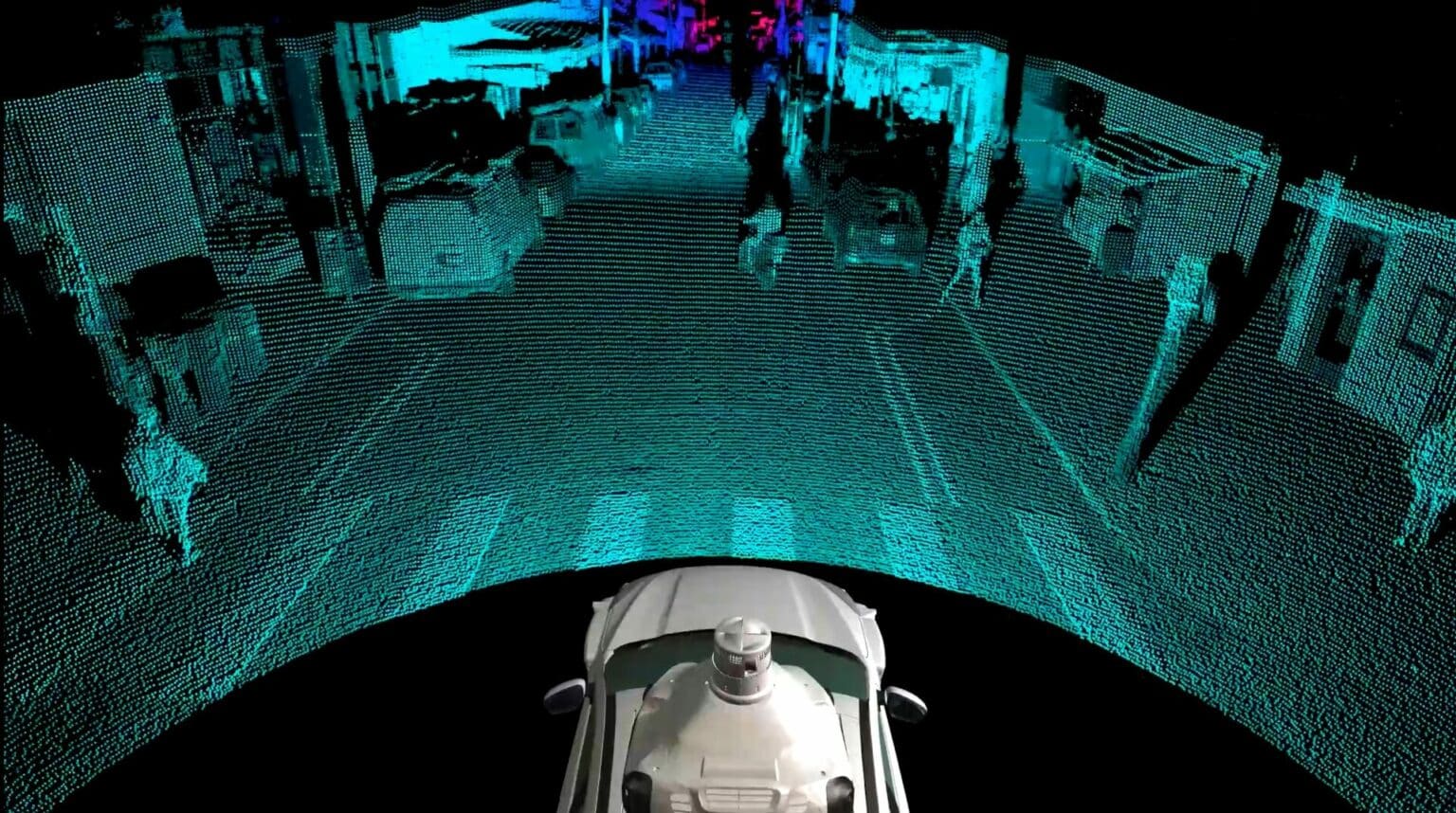

Lidarsysteme tasten ständig mit tausenden Laserstrahlen die Umgebung ab. Daraus entsteht ein digitales Abbild aller Objekte. Formen und Veränderungen geben einer Software Hinweise, ob es sich um Menschen, Autos oder Gebäude handelt. Sie interpretiert die Daten und überwacht den Bereich rund um das Auto. Da sich Lidargeräte nur auf ihr eigenes Licht verlassen, funktionieren sie nachts genauso gut wie am Tag.

Die Software berücksichtigt außerdem, dass verschiedene Objekte unterschiedlich auf Laserstrahlen reagieren. Schwarzer Autolack reflektiert Licht weniger stark als weißer Lack. Ziel der Lidar-Entwickler ist es, Systeme zu entwickeln, die in einer Entfernung von mehr als 200 Metern noch Objekte erkennen, die weniger als 3 Prozent Licht reflektieren – also tiefschwarz sind. Dabei müssen die Laserstrahlen ungefährlich für das menschliche Auge sein.

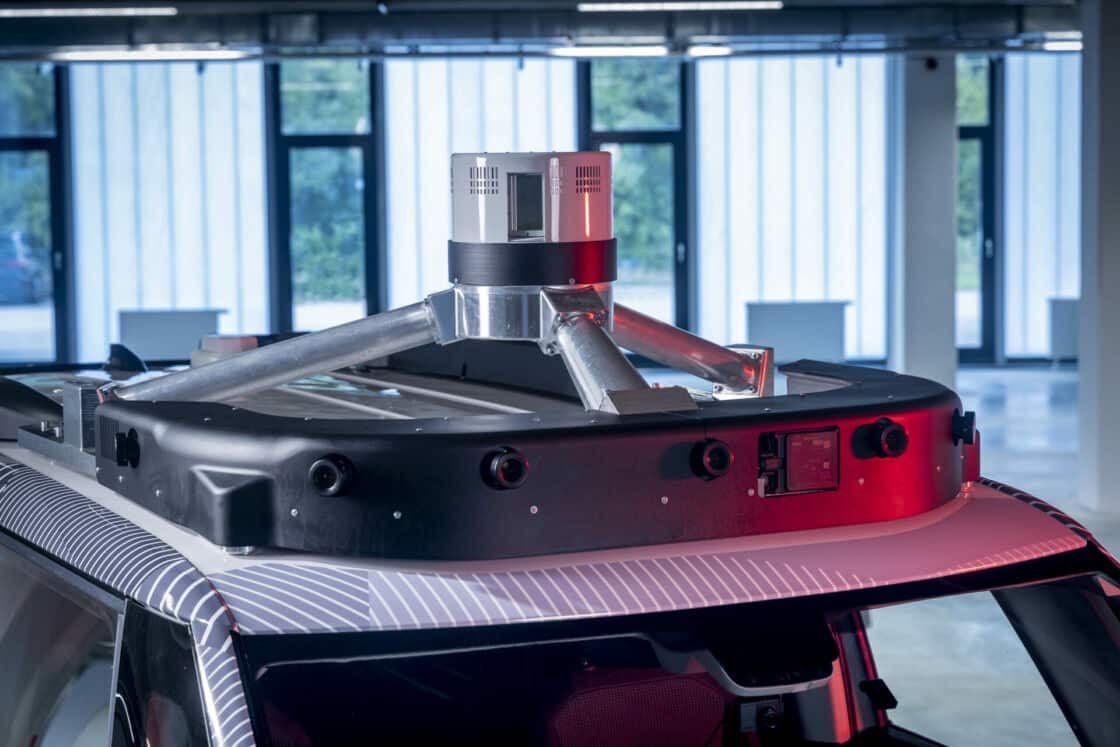

Einfache Lidarsysteme, wie die, die bereits im Fahrzeugbau zum Einsatz kommen, decken nur einen schmalen Bereich vor dem Auto ab. Bei Audi lenkt ein Spiegel in der Fahrzeugfront vier Laserstrahlen. Damit erreicht das System eine Reichweite von 80 Metern. Vollständig selbstfahrende Prototypen setzen auf rotierende 360-Grad-Lidarsysteme, die das gesamte Umfeld abtasten. Aktuell kosten solche Geräte noch ungefähr so viel wie ein Kleinwagen. Wenn sie in Serienproduktion gehen, sollen sie deutlich günstiger sein. Rudimentäres Lidar war einmal ähnlich teuer, mittlerweile steckt es sogar in Smartphones.

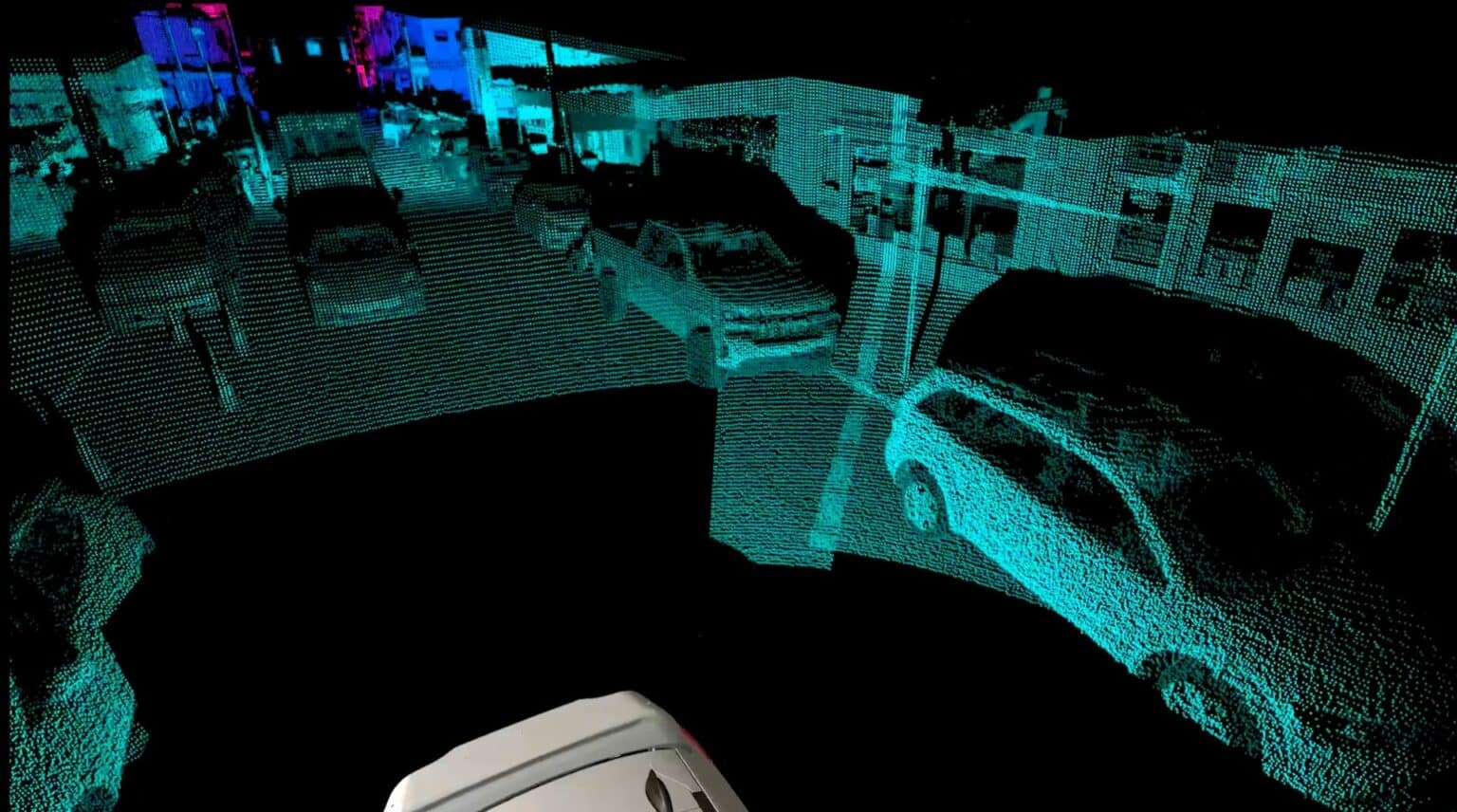

So sieht ein Lidar-Abbild aus

Eine der Firmen, die die Lidar-Technik für Autos entwickeln, heißt Argo AI. Das Unternehmen mit Sitz in Pittsburgh, Pennsylvania (USA) gehört zu je 40 Prozent Volkswagen und Ford. Es will gemeinsam mit VW in wenigen Jahren selbstfahrende Taxis in Hamburg anbieten. Umfangreich umgebaute Varianten des VW ID.Buzz lernen derzeit mit der Argo-Technik das autonome Fahren. Dazu sind am Auto mehrere Lidar- und Radarsensoren sowie einige Kameras angebracht.

Gemeinsam zeichnen diese Sensoren ein Bild, das aussieht wie manche es noch aus den „Matrix“-Filmen kennen: Viele einzelne Punkte ergeben eine dreidimensionale Umgebungskarte. Die Auflösung ist fein genug, um auf visualisierten Lidar-Abbildern Automodelle zu erkennen. Menschen, Bürgersteige und Laternen sieht das System problemlos. Im Idealfall kann es 400 Meter weit blicken.die

Darum ergänzen Kameras und Radarsensoren das Lidar

Allerdings genügt ein Lidar nicht, um autonomen Autos das Sehen beizubringen. Es kann keine Verkehrszeichen lesen. In einigen Fällen – zum Beispiel beim Stoppzeichen oder bei „Vorfahrt beachten“ – gibt die Form zwar Aufschluss über die Bedeutung. Ein Tempolimit kann das System dennoch nicht erkennen, trotz seiner unterschiedlichen Reaktion auf helle und dunkle Farben. An dieser Stelle müssen Kameras unterstützen.

Zudem legen Autohersteller viel Wert darauf, ihre Sensorik für das autonome Fahren redundant auszulegen. Fällt ein System aus, hilft ein anderes aus. Ein Roboterauto darf nicht plötzlich erblinden, weil ihm etwas die Sicht nimmt. Diese Absicherung rettet im Ernstfall Menschenleben.

Geht es auch ohne Lidar?

Fast alle Pkw-Entwickler vertrauen für das autonome Fahren auf den Laserscanner. Die große Ausnahme ist Tesla. Der Elektroauto-Hersteller aus Palo Alto verlässt sich auf Kamerabilder. Er verspricht, auf dieser Basis weitere autonome Funktionen zu entwickeln – für die nahe Zukunft unter anderem „automatisches Fahren innerorts“. Vorteil des Tesla-Ansatzes: Die Technologie könnte nachträglich in bereits verkauften Autos per Software-Update freigeschaltet werden. Tesla rüstet schon seit einigen Jahren Autos mit der entsprechenden Sensorik aus und kündigte an: Die Software kommt per Update ins Auto, sobald Gesetzgebung und Entwicklungsstand dies zulassen.

Im Internet finden sich zahlreiche Videos, die die intelligenten Algorithmen hinter Teslas Autonomie-Software aufzeigen. Die Programme erkennen z.B. frühzeitig Gefahrensituationen, die zunächst kaum als solche ersichtlich sind. Allerdings häufen sich die Meldungen über Unfälle, bei denen Teslas Autopilot versagte. So bleibt abzuwarten, ob der Hersteller mit entsprechender Software das Defizit in der digitalen Rundumsicht ausgleichen kann. Tesla kündigte kürzlich an, die Sensor-Hardware früher Modelle updaten zu wollen.

Weiterführende Artikel

Autonome S-Bahn fährt durch Hamburg

- Bus, Bahn, Ridepooling & Co.

Die Ampelschaltung der Zukunft wird schlau

- Politik und Wissenschaft

Autonomes Taxi: Waymo erweitert das Angebot

- E-Mobilität, Technik & Co.